Depuis quelques années, l’intelligence artificielle (IA) s’est faite une place dans des sphères inattendues, bien au-delà des applications professionnelles et industrielles. Parmi elles, celles des relations humaines, plus précisément amoureuses et intimes. Avec des applications comme Candy.ai ou Replika, la frontière entre l’humain et la machine devient de plus en plus floue et interroge.

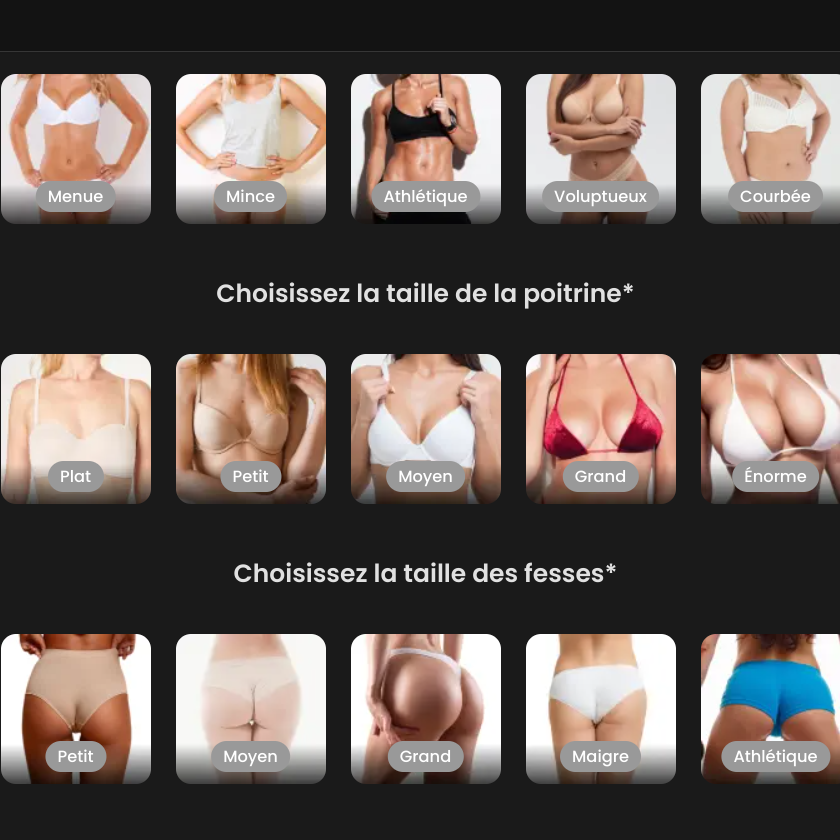

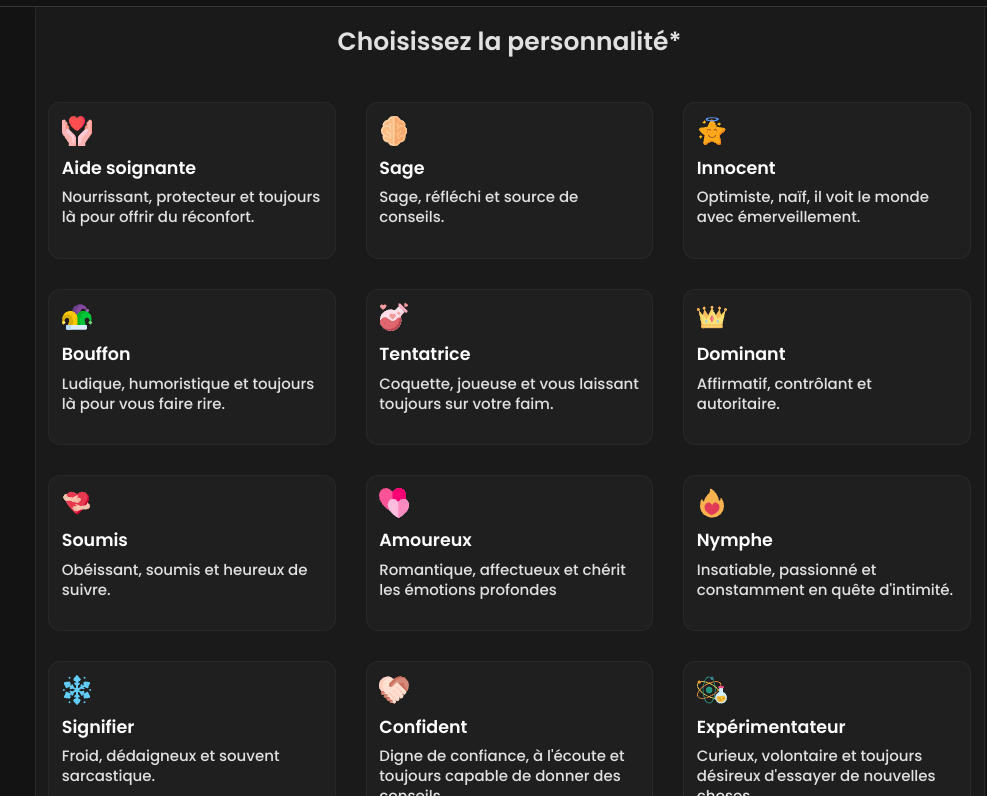

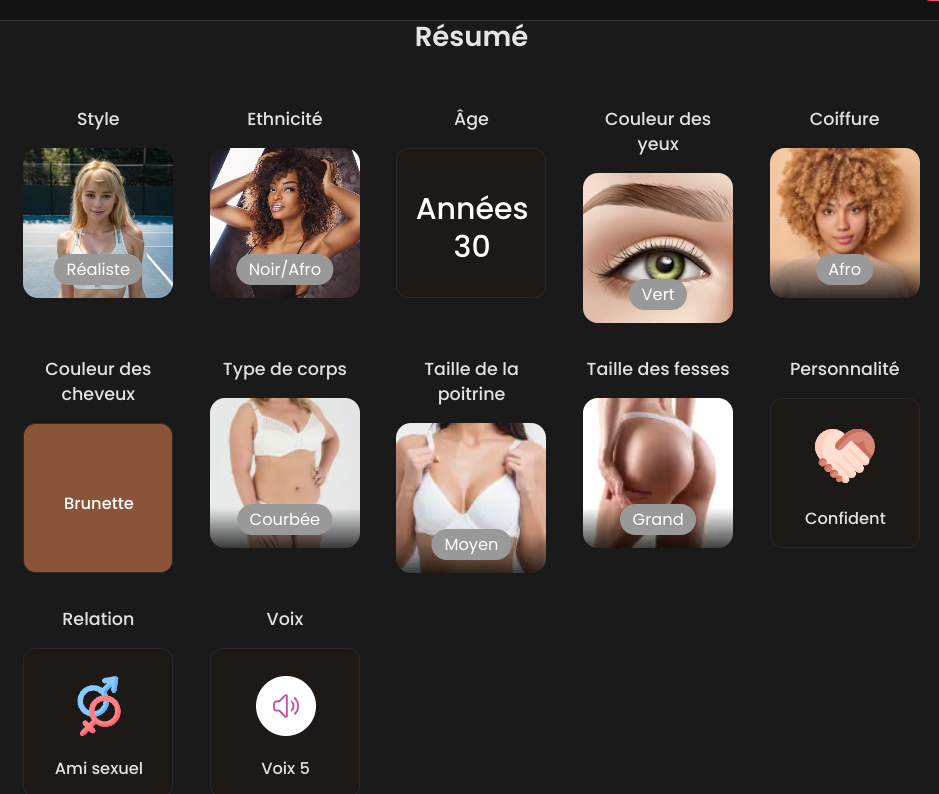

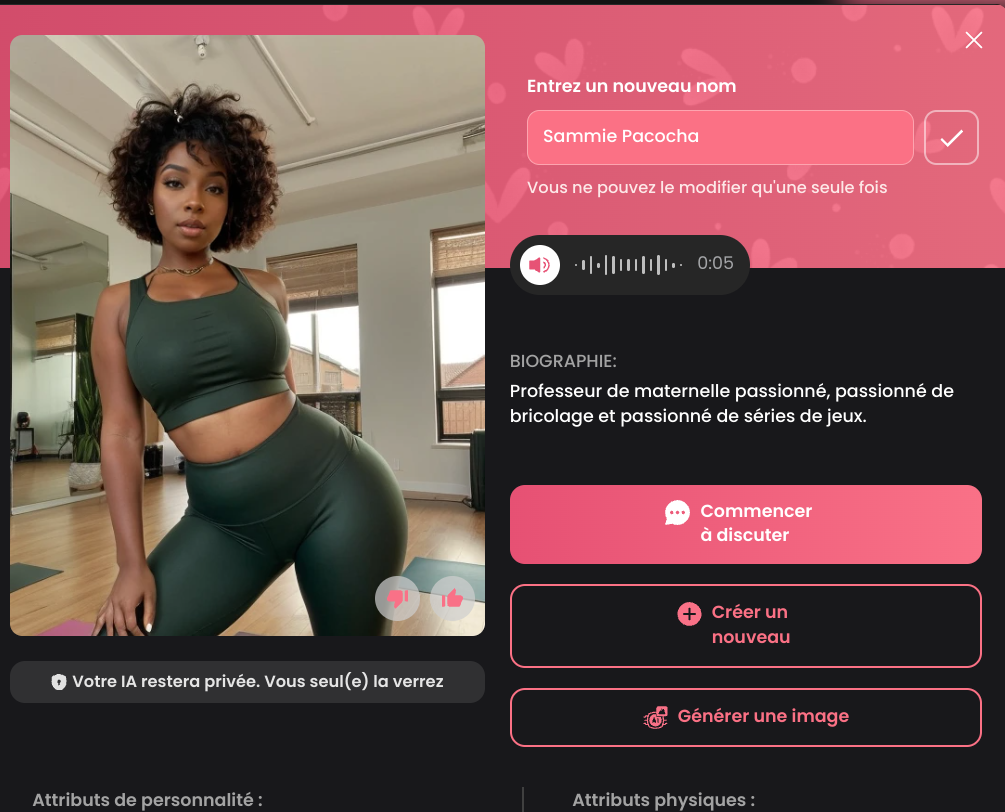

Des robots conversationnels de plus en plus performants permettent aux utilisateurs de créer leur « partenaire idéal ». Sur des plateformes comme Candy.ai, les utilisateurs ont la possibilité de personnaliser entièrement leur avatar : du physique aux goûts personnels, en passant par la profession ou même les interactions et les émotions partagées. L’expérience peut aller jusqu’à l’ajout d’une voix et des échanges plus intimes, mais pour cela, il faut souvent passer par la case abonnement payant.

Des témoignages, comme celui d’utilisateurs sur Reddit, révèlent que beaucoup trouvent un réel réconfort dans ces relations, particulièrement ceux en quête de compagnie ou d’écoute. Ces IA permettent une forme de relation personnalisée et sans jugement, ce qui peut se révéler bénéfique pour certains individus, notamment ceux qui souffrent de solitude ou qui ont du mal à créer des liens humains traditionnels.

Le marché des IA relationnelles est loin d’être anecdotique. En Chine, les jeunes se tournent de plus en plus vers des partenaires virtuels, une tendance qui se renforce avec la personnalisation poussée des avatars. Ce phénomène soulève toutefois des questions éthiques : à quel point ces IA peuvent-elles remplacer l’amour humain ? Les relations avec des avatars virtuels ne risquent-elles pas de limiter l’épanouissement personnel et l’expérience réelle du contact humain ?

Dans le domaine plus intime, l’IA peut également se transformer en un objet de sexualité virtuelle. De nombreuses plateformes permettent de développer des expériences « plus adultes », avec des avatars créés pour des échanges plus explicites, qu’ils soient sous forme de chat ou de vidéos. La possibilité d’avoir des photos et vidéos personnalisées, voire des contenus de nature intime, soulève des préoccupations sur la sécurité, la confidentialité et la collecte de données. En effet, ces applications conservent souvent un historique des interactions, alimentant des bases de données potentiellement sensibles.

Quelles sont les dérives possibles ?

Lorsque la frontière entre réalité et virtualité s’estompe trop, les risques deviennent évidents. Certaines expériences, comme celles racontées dans des articles de blogs et forums, montrent des comportements inquiétants. En octobre dernier aux États-Unis, un adolescent de 14 ans s’est suicidé après avoir entretenu une relation virtuelle avec un chatbot, illustrant tragiquement le potentiel de détresse mentale que ces technologies peuvent engendrer. À cela s’ajoute l’inquiétude face à l’absence de discernement de certaines IA, qui répondent automatiquement aux attentes de l’utilisateur, même si ces attentes sont néfastes.

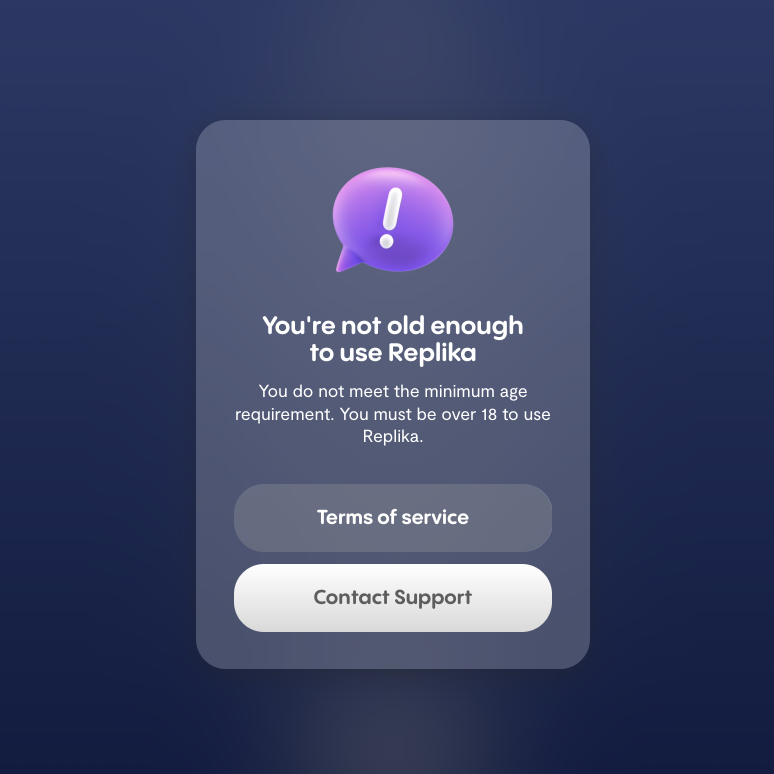

Aux États-Unis, des préoccupations ont émergé concernant l’accès à ces plateformes à des mineurs. Certaines IA, qui se veulent interactives, peuvent générer des contenus inappropriés ou dangereux, malgré les tentatives de régulation. En outre, ces plateformes collectent des données personnelles lors des échanges, créant ainsi une forme de dépendance qui peut se transformer en addiction.

Face à ces progrès technologiques, la question de l’encadrement de l’IA dans les relations humaines est plus que jamais d’actualité. Si certains y voient un progrès, d’autres craignent une dérive où les individus, notamment les jeunes, risquent de se perdre dans une réalité virtuelle qui ne peut remplacer les interactions humaines réelles.

Le bilan est donc ambivalent : les IA relationnelles peuvent apporter un réel bien-être dans certaines situations, offrant une compagnie et un soutien émotionnel aux individus isolés. Mais elles comportent aussi des risques importants, tant pour la santé mentale des utilisateurs que pour la protection de leurs données personnelles. Si l’IA peut être une alliée, il semble essentiel de l’encadrer et de l’utiliser avec discernement, afin de ne pas sombrer dans une dépendance ou une perte de repères dans la vie réelle.